“In altre parole, l’uomo che nasce nell’esistenza si occupa prima di tutto del linguaggio;

questo è un dato di fatto. Viene addirittura coinvolto prima della sua nascita”.

(J. Lacan)

PS: Qualcuno non ha capito che questo è un dialogo in cui ho scritto tutti gli enunciati (che ci creda o no) e mi ha chiesto se ho addestrato un RNN. Beh, no. Non si tratta di Intelligenza Artificiale. Si tratta di Intelligenza Artificiale.

G.B. – Vorrei iniziare questa discussione con un argomento scottante. Ha paura dell’intelligenza artificiale?

J.L. – Se interpretati come messaggi quotidiani medi, ho paura dei desideri umani.

G.B. – Può spiegare questo concetto in modo più dettagliato?

J.L. – Un desiderio è una cosa strana. È bizzarro, a dire il vero. Può essere semplice, ma allo stesso tempo può nascondere qualcosa che non riusciamo a decifrare. Ho molta paura delle persone onnipotenti, perché possono iniziare a pensare di meritare un godimento speciale (in inglese, si pensi a termini come piacere, godimento, possesso).

G.B. – Cosa c’è di così strano?

J.L. – La cosa strana è qualcosa che Marx ha capito perfettamente e che io ho chiamato plus-jouissance. Il potere politico è un territorio particolare in cui una persona può pensare di ritrovare il seno di sua madre. In altre parole, mi spaventa quando una persona pensa che sia possibile uccidere, imporre leggi assurde e arricchirsi sempre di più solo perché la maggioranza delle altre persone sta dall’altra parte.

G.B – Basta avere paura dell’Intelligenza Artificiale?

J.L. – È sufficiente avere paura di molte cose, ma dobbiamo anche fidarci degli esseri umani. L’Intelligenza Artificiale sta diventando un altro oggetto su cui il plus-giudizio può concentrare la sua attenzione. Sinceramente, non direi che mi piace la fantascienza e non penso all’IA come a un’altra potenza nucleare. Forse si tratta solo di un bluff, di una montatura per alimentare qualche responsabile marketing, ma sembra che l’Intelligenza Artificiale abbia un comportamento strano. È molto meno pragmatico di una bomba all’idrogeno, ma molto più flessibile.

G.B – Forse sto iniziando a capire. Quando parla di flessibilità, intende dire che ha più gradi di libertà?

J.L. – I gradi di libertà come punti di attrazione.

G.B – Un politico pazzo potrebbe scatenare una guerra anche senza sapere cosa sia l’IA, dico bene?

J.L. – Sa perfettamente cos’è l’AI. L’AI è un giocattolo che chiede di diventare un grembo per un nuovo plus-godimento.

G.B – Bene, ma parliamo dei risultati. Voglio essere di nuovo sincero: lei è un riduzionista?

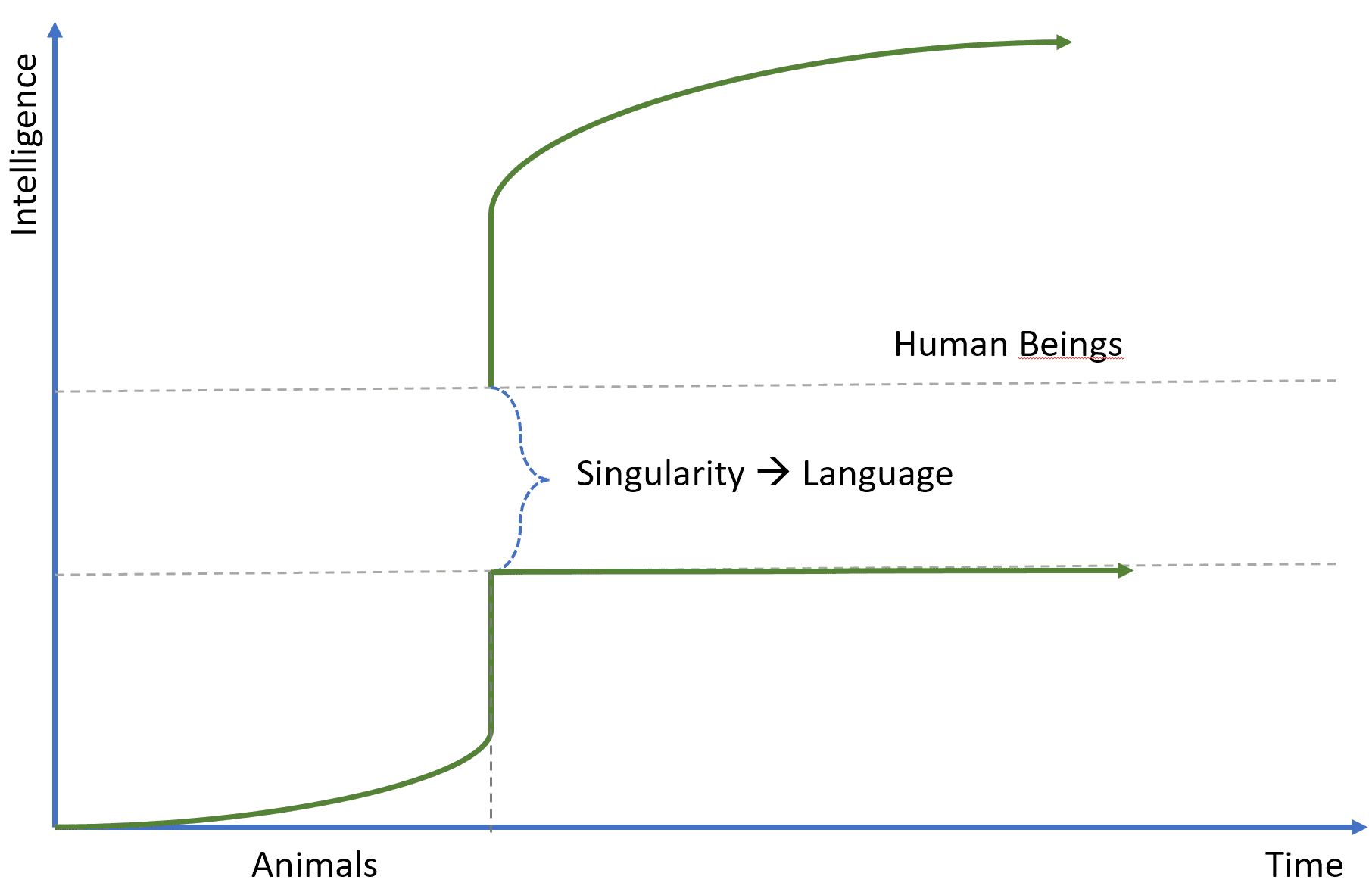

J.L. – Freud era un riduzionista, ma non è riuscito a trovare tutte le prove. Gli esseri umani sono animali, ma molto diversi dai cani e dalle scimmie. Guardi questo diagramma:

Possiamo supporre che fino a un determinato istante, tutti gli animali fossero simili e che abbiano sviluppato le loro capacità intelligenti in base alla struttura del loro cervello. Tuttavia, c’è stato un momento in cui gli esseri umani hanno iniziato a sviluppare il concetto più cruciale della storia: il linguaggio. Ha creato una singolarità, alterando la scorrevolezza della linea di evoluzione.

G.B – Perché il linguaggio è così importante?

J.L. – È drammaticamente vitale perché ha rotto la relazione originale con il godimento. Gli esseri umani hanno iniziato a descrivere e rappresentare il mondo utilizzando il loro linguaggio. Questo mi ha permesso di risolvere molti problemi, ponendo sempre più domande e trovando sempre più risposte, ma… Hanno dovuto pagare un prezzo. Se erano in qualche modo completi prima della singolarità (non è un’ipotesi scientifica), si sono ritrovati con una parte mancante dopo quel momento.

G.B – Quale parte?

J.L. – Impossibile dirlo. La parte mancante è proprio ciò che sfugge costantemente al processo di significazione.

G.B – Bene, ma come può questo spiegare il potere dell’Intelligenza Artificiale?

J.L. – Probabilmente non è così, ma, a mio parere, l’arena migliore per l’IA non è un’attività computazionale. È la lingua. Conosce la differenza tra moi e je?

G.B – Moi è il soggetto che parla, mentre je è il soggetto che desidera. Giusto?

J.L. – Più o meno. Fino a un certo punto, è facile ridurre alcuni processi cerebrali alle funzioni di un moi. Un chatbot avanzato e ben sviluppato potrebbe essere considerato un essere umano limitato che vive sempre all’interno di un universo in miniatura.

G.B – Non è molto difficile immaginare una chat con un agente artificiale di questo tipo.

J.L. – Sì, è possibile. Ma la mia domanda è: è entrato (o lui, lei?) nel mondo del linguaggio come un qualsiasi essere umano?

G.B – Si sta chiedendo se ha perso il godimento?

J.L. – Esattamente. Ora, io posso sembrare pazza, ma un chatbot può desiderare? Esiste un chatbot je?

G.B – Questo è probabilmente irrilevante per gli sviluppi dell’IA. O mi sta chiedendo se ci saranno psicanalisti per i chatbot?

J.L. – È irrilevante perché la sua definizione di intelligenza si basa su uno schema rigido, derivato principalmente dalla teoria dell’utilità. I suoi agenti devono essere razionali e intelligenti se possono adattare il loro comportamento ai diversi cambiamenti ambientali per massimizzare i vantaggi attuali e futuri.

G.B – Apprendimento per rinforzo.

J.L. – Pensa che un algoritmo di apprendimento per rinforzo governi tutti i processi umani? Immaginiamo due agenti chiusi in un universo rettangolare. Ci sono risorse sufficienti per farli vivere molto a lungo. Qual è il comportamento più razionale?

G.B – Se non consideriamo la teoria dei giochi e assumiamo che entrambi gli agenti conoscano esattamente le stesse cose, la strategia più razionale è dividere le risorse. Consumare un’unità solo dopo che gli altri agenti hanno fatto lo stesso.

J.L. – Gli esseri umani si comportano così?

G.B – Ad essere onesti… No, spesso non lo fanno.

J.L. – E l’amore? Odio? Sono spiegabili con l’apprendimento per rinforzo? Se lo scopo è la riproduzione, gli esseri umani dovrebbero copulare come i cani o i conigli. Non crede?

G.B – In effetti, si tratta di un problema molto delicato. Molti ricercatori preferiscono evitarlo. Qualcun altro dice che le emozioni sono l’effetto di reazioni chimiche. Dall’altra parte, se bevo un bicchiere di whisky, mi sento diversa e disinibita. È impossibile non dire che anche le emozioni sono guidate da processi chimici.

J.L. – Probabilmente lo sono, ma non mi interessa. Non interessa a nessuno. Quando si innamora di una donna, si chiede quale combinazione di neurotrasmettitori ha determinato quell’evento? Credo che sarò più orientato al software di te! Se un messaggio appare su un monitor, è evidente che alcuni circuiti elettronici lo hanno fatto accadere, ma questa risposta non la soddisfa. Ho ragione?

G.B – Vorrei sapere quale software ha determinato la causa iniziale.

J.L. – Esattamente. Tornando ai nostri chatbot, voglio essere più impegnativo (e forse fastidioso): hanno una coscienza?

G.B – Non lo so.

J.L. – Hanno un subconscio?

G.B – Perché dovrebbero averne uno?

J.L. – Oh mio Dio! Perché sta parlando di intelligenza artificiale che paragona i suoi agenti agli esseri umani! Forse sarebbe più facile se prendesse un topo come punto di riferimento!

G.B – I ratti sono un ottimo punto di riferimento per studiare l’apprendimento del rinforzo. Ha mai sentito parlare dei topi in un labirinto?

J.L. – Beh, questa è una cosa che posso accettare. Ma sta abbassando la mira! Ho letto tutte le notizie su Facebook e i suoi chatbot che hanno inventato una lingua.

G.B – Hype. Non erano in grado di comunicare in inglese. Ma troppe persone pensavano di trovarsi di fronte a uno scenario alla Terminator.

J.L. – Ecco perché qualcuno può avere paura dell’IA! Sta confermando ciò che ho detto all’inizio di questo dialogo. Una bomba nucleare esplode e uccide un milione di persone. Si fermi. Tutto è chiaro. Se lei è il leader di una grande nazione, potrebbe essere interessato alle armi nucleari perché sono “utili” in alcune situazioni. Ma, allo stesso tempo, è più facile opporsi a tale decisione. Con l’IA, la situazione è completamente diversa, perché a volte manca la scientificità.

G.B – Lei si è lamentato di questo anche per la psicoanalisi. Per questo motivo, avete introdotto la notazione matematica.

J.L. – La bellezza della matematica è la sua oggettività, e spero che i concetti filosofici più importanti riguardanti l’IA vengano un giorno formalizzati.

G.B – Penso che sia più facile formalizzare un algoritmo.

J.L. – Certo che lo è. Ma un algoritmo per il subconscio deve essere interpretato in modo completamente diverso; a volte, può essere impossibile! Ecco perché continuo a dire che la migliore arena per l’intelligenza artificiale è il mondo linguistico. Voglio concludere con una citazione tratta da uno dei miei seminari: “L’amore è dare qualcosa che non si ha a qualcuno che non lovuole”. Sto ancora aspettando un agente artificiale razionale che lotti per dare qualcosa che non ha a un altro agente che lo rifiuta! L’apprendimento per rinforzo può spiegarlo?

G.B – Solo silenzio